1. Inleiding

Tydens die Oscar-seremonie op 27 Maart 2022 het Will Smith die seremoniemeester, Chris Rock, geklap en uitgejou nadat Rock ’n onsensitiewe grap oor Smith se vrou, Jada Pinkett Smith, gemaak het. Rock het voorgestel dat Smith se vrou in GI Jane 2 kan speel, ’n duidelike verwysing na haar afgeskeerde hare (in GI Jane het Demi Moore ’n Navy Seal gespeel wat haar hare afgeskeer het). Smith se vrou ly egter aan ’n siekte, alopesie, wat veroorsaak dat haar hare uitval. Smith was blykbaar in die gesig gevat oor die bespotting van sy vrou se siekte en het haar eer probeer verdedig.

Daar was onmiddellik spekulasie dat die klap toneelspel was. Mense het daarop gelet dat Rock nie probeer het om homself te verdedig nie, dat hy geglimlag het, en dat hy nie werklik teruggesteier het nie. Boonop het Will Smith kort daarna die toekenning vir die beste akteur ontvang – as veteraan van vele aksiefilms is dit moontlik om te dink dat hy oortuigend sal kan voorkom as iemand wat sy humeur verloor en ’n ander man klap.

Hierdie beweerde toneelspel was glo om meer kykers na die Oscars te trek en dalk selfs om die aandag op Smith en Rock te vestig (Gilbert 2022; Rusk 2022; Ting 2022). Aantygings is ook gemaak dat die klap bedoel was om aandag af te trek van ander beweerde gebeurtenisse, byvoorbeeld beweerde menseregteskendings in die oorlog in Oekraïne (Dellinger 2022). ’n Ander voorstel is dat een van die borge van die Oscars, Pfizer, die gebeurtenis geskep het om mense bewus te maak van ’n middel wat Pfizer teen alopesie ontwikkel het (Silbert 2022). Daar is ook ’n gerug dat Rock ’n kussing op sy wang gedra het om die impak te verminder (Bilderbeck 2022). Daar is selfs een persoon wat beweer dat Will Smith self ’n namaaksel is en dat die regte Will Smith oorlede is (Fletcher 2022; Gilbert 2022), wat die vraag laat ontstaan of diepvervalsing (deepfake) nie ook in ag geneem behoort te word nie. Dellinger (2022) skryf oor verskeie samesweringsteorieë en verwys na die “Slap Truthers” – mense wat “weet” wat “werklik” gebeur het en ander wil “inlig”.

Volgens ’n kenner van liggaamsgedrag, Darren Stanton, was dit nie toneelspel nie (Hardiman 2022). Stanton glo Rock se houding suggereer dat hy nie ’n klap verwag het nie, omdat hy moontlik gedink het Smith kom maak ’n grap (Hardiman 2022). Toe Smith weer gaan sit het, het hy ook sy ken uitgestoot en lank oogkontak met Rock behou, wat tipiese aggressiewe gedrag is (Hardiman 2022). Smith het later baie emosioneel om verskoning gevra.

Die bevraagtekening van die egtheid van die klap vind nie in ’n vakuum plaas nie. In onlangse jare is die elites al hoe meer bevraagteken, met samesweringsteorieë rondom COVID-19 en die inenting daarteen, die WhatsApp-privaatheidsinstellingsdebakel, en die bevraagtekening van die eerlikheid van die Westerse media se uitbeelding van die oorlog in Oekraïne wat as enkele voorbeelde kan dien. Een gebruiker op TikTok argumenteer selfs dat die Romeinse Ryk nooit bestaan het nie (Mahan 2021). Ons leef in ’n tydsgewrig waar fopnuus alombekend geword het, en die bevraagtekening van die hoofstroom media se uitbeelding van gebeure het ’n welbekende faset van ons samelewing geword. Robert Thompson van Syracuse Universiteit se Bleier-sentrum vir televisie en populêre kultuur sê: “Believing everything you see – especially in the technology era – is naive. But not believing anything ever, no matter how much evidence comes out – that’s equally unhealthy and debilitating” (Anthony 2022). Mense sukkel egter om ’n balans te handhaaf.

Was die klap eg of toneelspel? Dit is ’n goeie geleentheid hierdie om ondersoek in te stel na hoe tegnologie die vraag sou kon beantwoord, indien enigsins.

2. Teksherkenning

Heelwat navorsing is reeds gedoen om aggressiewe gedrag op aanlyn platforms rekenaarmatig te identifiseer. Sulke studies ondersoek aggressie en afknouery in teks, met ander woorde dit gebruik kunsmatige intelligensie (KI) in die vorm van masjien- en diepleer vir die identifisering van aggressiewe taalgebruik (Rasel, Sultana, Akhter en Meesad 2018; Nikiforos, Tzanavaris en Kermanidis 2020; Gao, Yada, Wakamiya en Aramaki 2021; Nayak en Baek 2022). Martinez, Somandepalli, Singla, Ramakrishna, Uhls en Narayanan (2019) het ook gewys dat die vlak van geweld in ’n filmdraaiboek op grond van die taalgebruik met behulp van KI bepaal kan word.

Die vraag is of masjienleer in Will Smith se geval die onderskeid sal kan tref tussen werklike aggressiewe taalgebruik en toneelspel. Toe Smith weer gaan sit het en vir Rock geskree het: “Keep my wife’s name out of your f****** mouth!”, het dit eg voorgekom. Aangesien hy hierdie jaar die toekenning vir die beste akteur ontvang het, twyfel ek of masjienleer so ’n onderskeid sou kon tref.

3. Beeldherkenning

Daar is ook heelwat ontwikkeling op die gebied van video-ontleding vir die identifisering van geweld. Narynov, Zhumanov, Gumar, Khassanova en Omarov (2021) het byvoorbeeld KI gebruik om aggressiewe gedrag met behulp van videomateriaal te identifiseer, en bereik 97% akkuraatheid hiermee, terwyl Srividya, Anala en Tayal (2021) 89% akkuraatheid met ’n ander tegniek behaal het. Nadeem, Jalal en Kim (2020) het ook ’n masjienleermodel opgelei om liggaamsgedrag te herken wat gebruik sou kon word om aggressiewe gedrag te identifiseer, terwyl Soni en Singh (2018) klank en videomateriaal gebruik om kuberbullebakkery te identifiseer. Vele ander outeurs het ook reeds vordering op hierdie gebied gemaak (Das, Sarker en Mahmud 2019; Nova, Ferreira en Cortez 2019; Peixoto, Lavi, Pereira Martin, Avila, Dias en Rocha 2019; Ullah, Ullah, Muhammad, Haq en Baik 2019; Eitta, Barghash, Nafea en Gomaa 2021).

Geweldherkenning met behulp van videomateriaal is reeds kommersieel beskikbaar, byvoorbeeld deur Abto Software of iCetana, maar hierdie platforms is gemik op groter instellings eerder as die individuele gebruiker. Anders as voertuig- en mensherkenning, wat deesdae in die meeste slimhuiskameras ingebed is, is hierdie tegnologie nog nie wydverspreid nie.

In die geval van beeldherkenning is dit betwyfelbaar of masjienleer die onderskeid tussen ’n werklike klap en (goeie) toneelspel sal kan tref. Will Smith het Chris Rock werklik geklap – op die video kan duidelik gesien word dat Smith se hand kontak gemaak het met Rock se wang. Tegnologie sal hierdie feit bloot kan bevestig.

4. Liggaamsgedrag

Tchuente, Baddour en Lemaire (2020) toon dat gewelddadige gedrag deur slimhorlosies (byvoorbeeld die Apple Watch) en KI geïdentifiseer kan word. Wat veral interessant is van hierdie studie, is dat hulle ’n onderskeid getref het tussen hande klap (nie aggressief nie) en ’n klap (aggressief), wat in Will Smith se geval ’n aanduiding sou kon gee of die klap aggressief was of slegs toneelspel. Hierdie tegnologie is egter nog eksperimenteel en sal in elk geval verg dat Smith ’n slimhorlosie moet dra en ons toegang tot die data gee.

5. Emosies

KI kan ook gebruik word om mense se emosies te identifiseer (Devi, KarthikaRenuka en Soundarya 2018; Lu, Wang, Wu, Han, Zhang en Chen 2020; Salido Ortega, Rodríguez en Gutierrez-Garcia 2020; Yee Chung, Fuk So, Tak Choi, Man Yan en Shing Wong 2021). Op hierdie terrein is daar reeds verskeie slimfoontoepassings wat algemeen beskikbaar is, byvoorbeeld 3DiVi Face Recognition, ScamFace en Insights Develop. Al hierdie toepassings werk egter met gesigsuitdrukkings, en ander tegnieke soos hartklopherkenning is nie tans in hierdie toepassings beskikbaar nie. Toepassings wat hartklop monitor, soos Inner Balance, bestaan wel, maar dit verg ’n sensor op die persoon se lyf om die data te versamel.

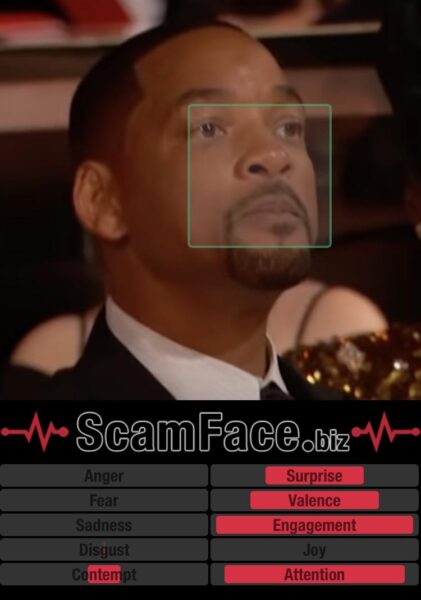

Ek het bogenoemde drie gesigherkenningstoepassings getoets om te kyk watter een, indien enige, iets sinvols oor die insident kan verskaf. Ek het die beste resultate met ScamFace gekry, soos in Figuur 1 gesien kan word. Hier is Will Smith se gesig net na hy “Keep my wife’s name out of your f****** mouth!” geskree het. Alhoewel die toepassing nie sy aggressie herken het nie, is ander relevante emosies duidelik.

Figuur 1. Will Smith se gesig net na hy “Keep my wife’s name out of your f****** mouth!” geskree het. Gesigsontleding deur die toepassing ScamFace.

Om emosies met behulp van gesigsuitdrukkings te identifiseer het waarde, maar in die geval van ’n ervare akteur soos Will Smith kan so ’n toepassing alleenlik sê dat hy óf werklik ontsteld was óf oortuigend voorgegee het dat hy ontsteld was. Indien Smith se hartklop beskikbaar was, sou daar met groter sekerheid bepaal kon word of sy uitbarsting eg of toneelspel was, maar die data is nie beskikbaar nie.

6. Diepvervalsing

Veronderstel die egtheid van die klap berus nie by Will Smith en Chris Rock se vermoë om toneel te speel nie, maar eerder by die videoredigeerder se vermoë om videomateriaal na te maak. Die tegnologie bestaan reeds hiervoor en sogenaamde diepvervalsing skep ’n groot uitdaging daarmee om videomateriaal te vertrou. Diepvervalsing behels die gebruik van KI om gesigte te verruil (face-swapping) en beteken dat ’n bekende persoon se gesig op iemand anders se lyf geplaas kan word wat iets binne ’n ander konteks doen (Maras en Alexandrou 2018). Gesigsverruiling kan byvoorbeeld met behulp van die toepassing Reface gedoen word.

Die gevaar met diepvervalsing is voor die hand liggend: Beskuldigings kan gemaak word met behulp van foto- en videomateriaal dat politici dinge gesê en gedoen het wat hulle nie het nie; mense se reputasie kan geskend word wanneer “hulle” in pornografiese kontekste uitgebeeld word, ens. Omdat hierdie tegnologie so ’n groot bedreiging is, is heelwat navorsing reeds daaraan gewy om diepvervalsing met behulp van KI te identifiseer (Guera en Delp 2018; Pantserev 2020; Godulla, Hoffmann en Seibert 2021; Sebyakin, Soloviev en Zolotaryuk 2021).

Die groot aantal reaksies van ander akteurs tydens die Oscars maak dit onmoontlik dat die insident die gevolg van diepvervalsing kan wees. Will Smith lewe en het Chris Rock geklap – daar kan nie twyfel hieroor bestaan nie. Tot dusver wil dit darem voorkom of die samesweringsteorie wat voorhou dat Will Smith oorlede is, tot ’n baie klein minderheid beperk is.

7. Slot

Hierdie artikel het ’n kort oorsig gegee oor invalshoeke wat met KI geneem sou kon word om te bepaal of dit werklik ’n aggressiewe klap was. Hartklopherkenning sou die oortuigendste antwoord bied, maar hiervoor word data benodig wat nie beskikbaar is nie. KI is nog in ’n ontwikkelingstadium en verbeter daagliks, beide ten opsigte van akkuraatheid en in die ontwikkeling van nuwe vaardighede. Dit bly egter ’n oop vraag of mense die antwoorde wat KI in die toekoms sal kan verskaf, sal aanvaar. Daar is immers mense wat volhou dat die aarde plat is.

Verwysings

Anthony, T. 2022. Why so many people thought the Oscars slap was staged. https://www.king5.com/article/entertainment/events/oscars/why-people-thought-the-oscars-slap-was-fake/507-237ff4f3-e4e7-43f9-8441-4ed1cab38a30 (29 Maart 2022 geraadpleeg).

Bilderbeck, P. 2022. Conspiracy theorists are claiming that Chris Rock wore a cheek pad before Will Smith slapped him. https://www.ladbible.com/entertainment/conspiracy-theorists-are-claiming-that-chris-rock-wore-a-cheek-pad-20220329 (30 Maart 2022 geraadpleeg).

Das, S, A Sarker en T Mahmud. 2019. Violence detection from videos using HOG Features, in 2019 4th International Conference on Electrical Information and Communication Technology (EICT), IEEE:1–5. doi: 10.1109/EICT48899.2019.9068754.

Dellinger, AJ. 2022. The Will Smith slap was a deep state conspiracy, apparently. https://www.mic.com/impact/will-smith-chris-rock-deep-state-qanon (30 Maart 2022 geraadpleeg).

Devi, CA, D KarthikaRenuka en S Soundarya. 2018. A survey based on human emotion identification using machine learning and deep learning, Journal of Computational and Theoretical Nanoscience, 15(5):1662–5. doi: 10.1166/jctn.2018.7358.

Eitta, AA, T Barghash, Y Nafea en W Gomaa. 2021. Automatic detection of violence in video scenes, in 2021 International Joint Conference on Neural Networks (IJCNN), IEEE:1–8. doi: 10.1109/IJCNN52387.2021.9533669.

Fletcher, H. 2022. QAnon think the Will Smith slap was faked because he is actually “dead”. https://www.indy100.com/viral/qanon-will-smith-dead-conspiracy (30 Maart 2022 geraadpleeg).

Gao, Z, S Yada, S Wakamiya en E Aramaki. 2021. A preliminary analysis of offensive language detection transferability from social media to video live streaming platforms, in Yada, Katagami, Takama, Ito, Abe, Sato-Shimokawara, Mori, Matsumura en Kashima (reds), Advances in Artificial Intelligence: Selected Papers from the Annual Conference of Japanese Society of Artificial Intelligence (JSAI 2020). Cham: Springer International Publishing (Advances in intelligent systems and computing):121–32. doi: 10.1007/978-3-030-73113-7_11.

Gilbert, D. 2022. Will Smith slapped Chris Rock and QAnon is starting conspiracies about it. https://www.vice.com/en/article/g5qnw7/will-smith-slap-qanon (30 Maart 2022 geraadpleeg).

Godulla, A, CP Hoffmann en D Seibert. 2021. Dealing with deepfakes – an interdisciplinary examination of the state of research and implications for communication studies. Studies in Communication and Media, 10(1):72–96. doi: 10.5771/2192-4007-2021-1-72.

Guera, D en EJ Delp. 2018. Deepfake video detection using recurrent neural networks, in 2018 15th IEEE International Conference on Advanced Video and Signal Based Surveillance (AVSS), IEEE:1–6. doi: 10.1109/AVSS.2018.8639163.

Hardiman, J. 2022. Body language expert explains whether Will Smith slap was real or fake. https://www.ladbible.com/entertainment/body-language-expert-explains-whether-will-smith-slap-was-real-or-fake-20220328 (30 Maart 2022 geraadpleeg).

Lu, Y, M Wang, W Wu, Y Han, Q Zhang en S Chen. 2020. Dynamic entropy-based pattern learning to identify emotions from EEG signals across individuals, Measurement, 150, bl 107003. doi: 10.1016/j.measurement.2019.107003.

Mahan, L. 2021. The Internet’s newest conspiracy theory is that Ancient Rome never existed. https://www.insidehook.com/daily_brief/internet/roman-empire-never-existed-tiktok (30 Maart 2022 geraadpleeg).

Maras, M-H en A Alexandrou. 2018. Determining authenticity of video evidence in the age of artificial intelligence and in the wake of Deepfake videos, The International Journal of Evidence & Proof, 136571271880722. doi: 10.1177/1365712718807226.

Martinez, VR, K Somandepalli, K Singla, A Ramakrishna, YT Uhls en S Narayanan. 2019. Violence rating prediction from movie scripts, Proceedings of the AAAI Conference on Artificial Intelligence, 33:671–678. doi: 10.1609/aaai.v33i01.3301671.

Nadeem, A, A Jalal en K Kim. 2020. Human actions tracking and recognition based on body parts detection via artificial neural network, in 2020 3rd International Conference on Advancements in Computational Sciences (ICACS), IEEE:1–6. doi: 10.1109/ICACS47775.2020.9055951.

Narynov, S, Z Zhumanov, A Gumar, M Khassanova en B Omarov. 2021. Detecting school violence using artificial intelligence to interpret surveillance video sequences, in Wojtkiewicz, Treur, Pimenidis en Maleszka (reds), Advances in computational collective intelligence: 13th international conference, ICCCI 2021. Cham: Springer International Publishing (Communications in computer and information science):401–12. doi: 10.1007/978-3-030-88113-9_32.

Nayak, R en HS Baek. 2022. Machine learning for identifying abusive content in text data, in Virvou, Tsihrintzis en Jain (reds), Advances in selected artificial intelligence areas: world outstanding women in artificial intelligence. Cham: Springer International Publishing (Learning and analytics in intelligent systems), ble 209–29. doi: 10.1007/978-3-030-93052-3_9.

Nikiforos, S, S Tzanavaris en K-L Kermanidis. 2020. Virtual learning communities (VLCs) rethinking: influence on behavior modification—bullying detection through machine learning and natural language processing, Journal of Computers in Education, 7(4):531–551. doi: 10.1007/s40692-020-00166-5.

Nova, D, A Ferreira en P Cortez. 2019. A machine learning approach to detect violent behaviour from video, in Cortez, Magalhães, Branco, Portela en Adão (reds), Intelligent Technologies for Interactive Entertainment: 10th EAI International Conference, INTETAIN 2018, Guimarães, Portugal, November 21–23, 2018, Proceedings. Cham: Springer International Publishing (Lecture notes of the institute for computer sciences, social informatics and telecommunications engineering), ble 85–94. doi: 10.1007/978-3-030-16447-8_9.

Pantserev, KA. 2020. The malicious use of AI-based deepfake technology as the new threat to psychological security and political stability, in Jahankhani, Kendzierskyj, Chelvachandran en Ibarra (reds), Cyber defence in the age of AI, smart societies and augmented humanity. Cham: Springer International Publishing (Advanced sciences and technologies for security applications), ble 37–55. doi: 10.1007/978-3-030-35746-7_3.

Peixoto, B, B Lavi, JP Pereira Martin, SAvila, Z Dias en A Rocha. 2019. Toward subjective violence detection in videos, in ICASSP 2019 – 2019 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP), IEEE:8276–8280. doi: 10.1109/ICASSP.2019.8682833.

Rasel, RI, N Sultana, S Akhter en P Meesad. 2018. Detection of cyber-aggressive comments on social media networks: a machine learning and text mining approach, in Proceedings of the 2nd International Conference on Natural Language Processing and Information Retrieval – NLPIR 2018: ACM Press, ble 37–41. doi: 10.1145/3278293.3278303.

Rusk, C. 2022. Will Smith’s Chris Rock Oscars smack sends viewers wild with conspiracy theories. https://www.mirror.co.uk/3am/celebrity-news/smiths-chris-rock-oscars-smack-26571487 (30 Maart 2022 geraadpleeg).

Salido Ortega, MG, L-F Rodríguez en JO Gutierrez-Garcia. 2020. Towards emotion recognition from contextual information using machine learning, Journal of Ambient Intelligence and Humanized Computing, 11(8):3187–3207. doi: 10.1007/s12652-019-01485-x.

Sebyakin, A, V Soloviev en A Zolotaryuk. 2021. Spatio-temporal deepfake detection with deep neural networks, in Toeppe, Yan en Chu (reds), Diversity, Divergence, Dialogue: 16th International Conference, iConference 2021, Beijing, China, March 17–31, 2021, Proceedings, Part I. Cham: Springer International Publishing (Lecture notes in computer science), ble 78–94. doi: 10.1007/978-3-030-71292-1_8.

Silbert, J. 2022. No, Will Smith’s Oscars slap was not a big pharma conspiracy. https://www.highsnobiety.com/p/will-smith-oscars-2022-slap-alopecia-pfizer (30 Maart 2022 geraadpleeg).

Soni, D en VK Singh. 2018. See no evil, hear no evil, Proceedings of the ACM on Human-Computer Interaction, 2(CSCW), ble 1–26. doi: 10.1145/3274433.

Srividya, MS, MR Anala en C Tayal. 2021. Deep learning techniques for physical abuse detection, IAES International Journal of Artificial Intelligence (IJ-AI), 10(4):971. doi: 10.11591/ijai.v10.i4, ble 971–81.

Tchuente, F, N Baddour en ED Lemaire. 2020. Classification of aggressive movements using smartwatches, Sensors, 20(21). doi: 10.3390/s20216377.

Ting, E. 2022. The elites are lying to you about the Will Smith-Chris Rock slap at the Oscars. https://www.sfgate.com/streaming/article/truth-about-Will-Smith-Oscars-slap-17033792.php (30 Maart 2022 geraadpleeg).

Ullah, FUM, A Ullah, K Muhammad, IU Haq en SW Baik. 2019. Violence detection using spatiotemporal features with 3D Convolutional Neural Network, Sensors, 19(11). doi: 10.3390/s19112472.

Yee Chung, JW, HC Fuk So, MM Tak Choi, VC Man Yan en TK Shing Wong. 2021. Artificial Intelligence in education: Using heart rate variability (HRV) as a biomarker to assess emotions objectively, in Computers and Education: Artificial Intelligence, 2:100011. doi: 10.1016/j.caeai.2021.100011.

Kommentaar

Baie dankie hiervoor! Uitstekend.